Vertrauen Sie dem Algorithmus ruhig!

Misstrauen ist das neue Emblem der kritischen Bürger*innen. Der französische Historiker Pierre Rosanvallon spricht davon, dass wir in einer heranwachsenden "Misstrauensgesellschaft" leben. Nicht nur sind unsere Fakten heute heiß umkämpft, sondern auch die Autoritäten derer, die sie uns vermitteln. Medien, Politiker*innen, Expert*innen – die Liste derer, denen wir nicht mehr vertrauen (sollen), ist lang. Im Alltag allerdings spielt Vertrauen eine größere Rolle, als wir vielleicht denken. Zum Beispiel vertrauen wir intuitiv darauf, dass wir uns auch in ungewohnten und fremden Momenten zurechtfinden und improvisieren können. Der Soziologe Niklas Luhmann bezeichnete Vertrauen als Mittel, um all die Komplexität von Nichtwissen in einer Gesellschaft zu reduzieren: Es sei der Stoff, der die Gesellschaft zusammenhält.

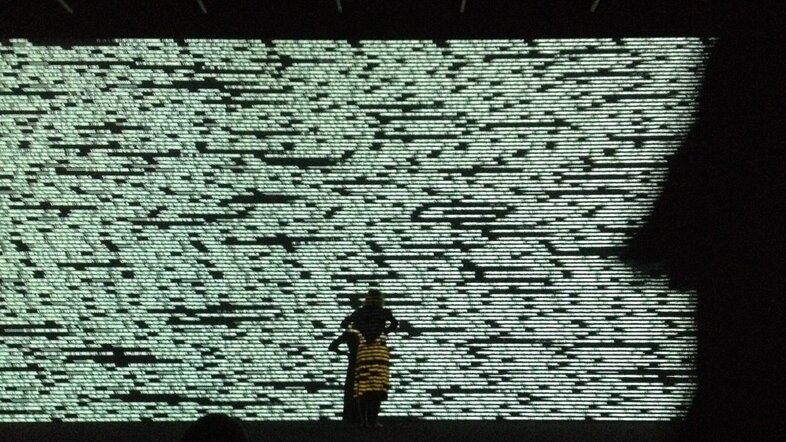

Die Sache mit dem Vertrauen wird komplizierter, wenn neue, "unheimliche" Technologien dazukommen. Besonders die unsichtbaren Algorithmen und ihre Intelligenz stellen das Vertrauensverhältnis zwischen Menschen, Technik und Autoritäten auf die Probe. Das ist auch grundsätzlich gut so. Nehmen wir autonomes Fahren als Beispiel. Noch vor wenigen Jahren gab es rund um selbstfahrende Autos eine unglaubliche Euphorie und große Versprechen. Es hieß, KI-gesteuerte Fahrzeuge seien im Anmarsch, in Wahrheit schleichen sie eher heran.

Der Irrglauben scheint oft, dass autonomes Fahren etwas mit totaler Fahrsicherheit zu tun hätte, die gibt es aber nicht. Was Ethiker*innen in diesem Zusammenhang beschäftigt, ist die Frage, ob diese Systeme Verhältnismäßigkeit verstehen. Unfälle vermeiden wäre schön, aber Algorithmen scheitern eher daran, dass sie nicht mit Chaos und Ungereimtheiten umgehen können. Wird das Auto ausweichen, auch wenn ich bei Rot über die Straße gehe? Denn Verkehr ist auch Chaos, und einer Maschine Chaos beizubringen bedeutet, sie Ambiguität und Regelbruch zu lehren. Darauf sollten wir erstmal nicht vertrauen. Was zeigt uns das? Vertrauen fängt dort an, wo wir Entscheidungen in Technologien auslagern wollen aber nicht sicher wissen, ob wir das können und wie sie ausgeführt werden.

Vertrauen ist gut, aber Kritik besser

Es gibt Good News. Algorithmen sind intransparent, aber keine zufälligen Anweisungen. Meist sind Algorithmen schnellere Datenverarbeiter und erleichtern oder ermöglichen sinnvolle (wenn auch nicht immer perfekte) Prognosen. Die COVID-19 Pandemie wäre ohne Künstliche Intelligenz nicht zu managen, klingt bürokratisch, rettete aber Leben. Die globalen Zusammenhänge der Klimakrise wären auch nicht fassbar, und die Folgen nicht so schockierend klar.

Für viele Forscher*innen und Philosoph*innen ist Vertrauen in Algorithmen eine Frage von Wissen – Stichwort Medienkompetenz bzw. Algorithmus-Verständnis. Das klingt in der Theorie gut, kann aber auch Tücken haben. Denn eine bessere technische Medienkompetenz könnte auch dazu führen, dass Menschen neuen Technologien weniger kritisch gegenüberstehen. Da wären wir dann beim Knackpunkt: Was ist wirklich kritisch? Alles genau wissen zu wollen ist nicht unbedingt ein Zeichen von Vertrauen, ebenso wenig wie kritisch sein mit generellem Misstrauen gleichzusetzen ist. Je mehr ich wissen muss, umso weniger vertraue ich. Das gilt für die Digitalisierung genauso wie für menschlichen Beziehungen: Wir wollen dann mehr wissen, wenn sich Misstrauen einschleicht.

Es gibt also auch Bad News. Algorithmen sind bald überall, auch ohne unser Vertrauen. Wir wissen weder, wie sie ticken, noch was sie genau machen. Finanzen, Gesundheit, Kommunikation – alles ist algorithmisiert. Soll heißen, unser Verhalten ist unterschwellig lenkbar, dokumentiert und vorhersehbar. Die wirklich schlechten Neuigkeiten sind aber, dass hinter allen Algorithmen Menschen oder Firmen stecken. Viele davon meinen es weder gut mit unseren Daten, noch mit unserem Vertrauen. Hier wären wir beim kritischen Punkt: Vertrauen ist ein Luxus derer, die zur Norm gehören. Für diejenigen, die aus der Reihe tanzen, führt die algorithmische Welt oft zu noch mehr Benachteiligung. Für Frauen und LGTBQI+ Menschen gehört algorithmische Benachteiligung zum Alltag. Vertrauen wäre hier fehl am Platz.

Vertrauen hat Wert, auch kritischen

Sollen wir also die Algorithmen boykottieren? Unmöglich. Die nächste Finanzamt-App lauert schon um die Ecke. Wir brauchen aber mehr Stimmen querbeet und mitten durch alle Gesellschaftsschichten, die sich dem Thema kritisch gegenüberstellen, und wir brauchen stärkere Bünde gegen Daten-Monopole. Klingt vielleicht utopisch, ist aber ernstgemeint. Vertrauen und Wissen bedingen sich nicht unbedingt, aber sie helfen einander.

In Zeiten von Digitalisierung sollten wir unser Vertrauen als Machtmittel verstehen: Es ist wortwörtlich etwas wert. Wir können es öfter entziehen, als wir glauben. Während selbstfahrende Autos weiter weg scheinen, war der AMS-Algorithmus in Österreich ganz nahe, und eine durchaus problematische Anwendung. Jedoch stieß dieser auf derart großen ethischen, rechtlichen und sozialen Widerstand, dass wir hier sehen können, wie fundiertes Misstrauen auch etwas bewirken kann. Nur dagegen sein, scheint naiv. Jedoch haben wir die Wahl öfter zu misstrauen und als Gesellschaft aufzutreten, denn darin sind wir Algorithmen weit überlegen.

Studiert hat sie Rechtswissenschaften und Gesellschafts- und Wirtschaftskommunikation in Berlin, Philosophie in der Schweiz und Transdisziplinäre Studien in England. Sie behandelt dabei Entwicklungen bezüglich KI und Klimakrise, Diskriminierung, Misstrauen und Plattformkritik. Aktuell arbeitet Eugenia Stamboliev im Projekt "Explainability und Interpretability as Drivers of Democracy", das vom Wiener Wissenschafts-, Forschungs- und Technologiefonds (WWTF) gefördert ist.